- 2025-02-13

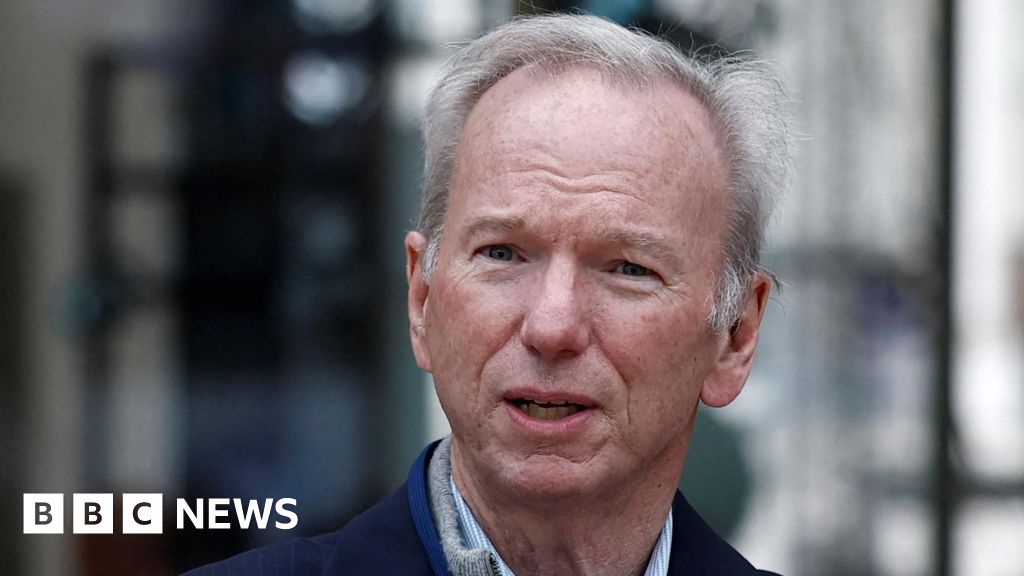

Ex-Google-chef Eric Schmidt fruktar för ’bin Laden’ AI-scenario

Den tidigare verkställande direktören för Google är orolig konstgjord intelligens kan användas av terrorister eller ”skurkstater” för att ”skada oskyldiga människor.” Eric Schmidt sa till BBC: ”Den verkliga rädslan som jag har inte är de som de flesta pratar om AI. . krävde regeringens övervakning av privata teknikföretag som utvecklar AI-modeller, men varnade överreglering kunde kväva innovation. Biden begränsade exporten av mikrochips till alla utom 18 länder för att bromsa motståndarnas framsteg på AI -forskning. Beslutet kan fortfarande vändas av Donald Trump. ”Tänk på Nordkorea, eller Iran, eller till och med Ryssland, som har något onda Mål, ”sa Schmidt.” Denna teknik är tillräckligt snabb för att de skulle kunna anta att de kunde missbruka den och göra verklig skada, ”berättade han för Today Presenter Amol Rajan. Han tillade AI -system, i fel händer, kunde användas för att utveckla för att utveckla Vapen för att skapa ”en dålig biologisk attack från någon ond person.” ”Jag är alltid orolig för det” Osama Bin Laden ”-scenariot, där du har någon riktigt ond person som tar över någon aspekt av vårt moderna liv och använder det för att skada det Oskyldiga människor, ”sade han. Bin Laden orkestrerade attackerna den 9/11 2001, där al-Qaida terrorister tog kontroll över flygplan för att döda tusentals människor på amerikansk jord. Schmidt föreslog en balans mellan regeringens övervakning av AI-utvecklingen och överreglering av sektorn. ”Sanningen är att AI och framtiden till stor del kommer att byggas av privata företag,” sa Schmidt. ”Det är verkligen viktigt att regeringar förstår Vad vi gör och håller ögonen på oss. ”Han tillade:” Vi hävdar inte att vi ensidigt skulle kunna göra dessa saker utan tillsyn, vi tycker att det borde regleras. ”Han talade från Paris, där AI Action Summit avslutade med USA och Storbritannien vägrade att underteckna avtalet. USA: s vice president JD Vance sa att regleringen skulle ”döda en transformativ industri precis som den tar fart”. MR Schmidt sa att resultatet av för mycket reglering i Europa ”är att AI -revolutionen, som är den viktigaste revolutionen enligt min åsikt sedan el, kommer inte att uppfinnas i Europa. ”Han sa också att de stora teknikföretagen” inte förstod för 15 år sedan ”potentialen som AI hade, men gör nu. ”Min erfarenhet av de tekniska ledarna är att de har en förståelse för den inverkan de har, men de kan göra olika värderingar än regeringen skulle göra,” sade han. MR Schmidt var chef för Google när företaget köpte Android, företaget som nu gör det mest använda mobiltelefonens operativsystem i världen. Han stöder nu initiativ för att hålla telefoner utanför skolorna. ”Jag är en av de människor som inte förstod, och jag tar ansvar att världen inte fungerar perfekt på det sätt som amerikanska tekniker tror att det är,” sade han. ”Situationen med barn är särskilt störande för mig. ”” Jag tror att smartphones med ett barn kan vara säkra, ”sade han,” de behöver bara modereras … Vi kan alla vara överens om att barn ska skyddas från onlinevärldens dåliga. ”På sociala medier – där han Har stött förslag till ett förbud mot barn under 16 år – han tillade: ”Varför skulle vi driva ett så stort, okontrollerat experiment på de viktigaste människorna i världen, vilket är nästa generation?” Kampanjer för att begränsa barnens smartphoneanvändning argumentera telefoner är beroendeframkallande och ”har lockat barn bort från de aktiviteter som är nödvändiga för en sund utveckling”. Australiens parlament antog en lag för att förbjuda sociala medier för under 16 år 2024, med premiärminister Anthony Albanese som säger att det var viktigt att skydda barn från dess ” skadar ”. En ny studie som publicerades i Medical Journal The Lancet föreslog att mobiltelefonförbud i skolor inte förbättrade elevernas beteende eller betyg. Men det fann att utgifterna längre på smartphones och sociala medier i allmänhet var kopplat till sämre resultat för alla dessa åtgärder .